最终,我们希望将该技术设计成一幅电子眼镜,我们亲切地称为“Smart Specs”。这种眼镜将让更多视障人士可以生活更独立,帮助他们找出附近的物体、观察他们的周围环境。批量生产后,Smart Specs的成本将与一台现代化的智能手机相当。其性能与一只经过充分训练的导盲犬相当,但却便宜得多。

搭建义肢仿真环境来验证我们的设计

首先我们从仿真视网膜义肢的功能开始,探讨如何提高低分辨率显示图像所能提供的信息量。我们使用LabVIEW和NI视觉开发模块来开发仿真软件。该模块可支持多种不同的相机类型,给我们提供了现成的图像处理函数、图像采集驱动、显示功能和图像记录功能。我们无需大量的开发就可以快速地采集原始图像。我们已经发表了我们的方法和结果(van Rheede, Kennard and Hicks. Journal of Vision 2010)。

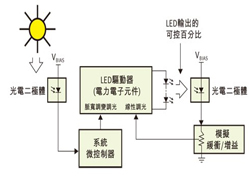

在这第一项的研究中,我们提出了使用机器视觉来简化视频流中的重要信息,重新生成一幅明亮,低分辨率的图像,这样的图像也许可以帮助那些只有最低视觉能力的人士。接下来,我们开始了现在正在进行的研究,这个研究就完全基于LabVIEW、NI-IMAQ和Vision。

我们按照下列开发步骤来创建我们的系统:

1 失明仿真。

2 开发实时图像优化,如边缘检测和对比度优化等。

3 开发实时的对象检测算法,探索不同的方法来对图像进行简化,输出适合具有严重视觉障碍人观察的明亮图像。

4 开发一套快速的脸部检测算法来连接到简化的图像输出。

5 开发实时且不受方向限制的文字识别算法。.

我们分别在健康对照组(在仿真失明条件下)和一个失明者身上使用上面描述的技术进行了原理验证性研究。结果两者都可以很容易地发现和识别出我们系统所处环境中的物体,而这些物体以往是看不到的。