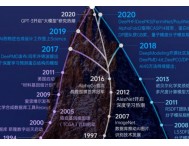

Claude 3模型家族包括三种最先进的型号:Claude 3 Haiku、Claude 3 Sonnet 和 Claude 3 Opus。Haiku、Sonnet和Opus分别指“俳句、十四行诗、音乐艺术大作”。

Opus和Sonnet现已可在claude.ai中使用,而 Claude API现已在159个国家/地区广泛使用。Haiku在3月15日正式推出。

Anthropic由OpenAI前高管创立,投资者包括谷歌、Salesforce、亚马逊、高通等科技巨头,估值超过150亿美元。

零一万物发布并开源 Yi-9B,代码数学综合能力全面增强

3月6日,零一万物开源了Yi-9B模型,是目前 Yi 系列模型中代码和数学能力最强的模型。

Yi-9B的实际参数为8.8B,与Yi系列其他模型一样,默认上下文长度是4K tokens。Yi-9B是在 Yi-6B (使用了3.1T tokens训练)的基础上,使用了0.8T tokens进行继续训练,使用截止至2023年6月的数据。

Inflection.ai发布 Inflection-2.5,升级对话模型Pi

3月7日,Inflection.ai推出Inflection-2.5,这是升级后的内部模型,它将原始能力与标志性个性和独特的同理心微调结合在一起。Inflection-2.5现已向所有Pi用户开放,可通过网页、iOS、Android或桌面应用程序使用。

Inflection-2.5接近GPT-4的性能,但仅使用了40%的计算量用于训练。每天有100万活跃用户和每月600万活跃用户与Pi交换了超过40亿条消息。

Inflection.ai的大模型通过微软Azure、CoreWeave上对用户提供服务。

马斯克宣布xAI本周开源Grok

马斯克在去年成立了大模型公司xAI,并与去年11月发布AI聊天机器人Grok。

Grok基于Grok-1大模型,开发大约花了四个月的时间(包括2个月的训练),上下文长度为8192,训练数据截至2023年第三季度。Grok可以提供生成文本、代码、邮件、信息检索等功能。Grok对所有X Premium+订阅用户开放,每月费用为16美元。

3月11日,马斯克宣布本周开源Grok。在这一帖子下面,有网友回复“OpenAI也应该这么做”。马斯克则回复该评论称:“OpenAI是个谎言。”

苹果发布300亿参数大语言模型MM1

3月14日,苹果发布了一个300亿参数的多模态大模型MM1。

通过细致的消融研究,作者们发现,对于大规模多模态预训练,混合使用图像标题、交错的图像-文本数据和纯文本数据对于在多个基准测试中实现最先进的少次学习结果至关重要。此外,图像编码器、图像分辨率和图像标记数量对性能有显著影响,而视觉-语言连接器的设计相对不那么重要。

研究结果表明,通过扩大模型规模,构建的MM1模型系列在预训练指标上达到了最先进的水平,并在一系列多模态基准测试中的监督微调后取得了有竞争力的性能。大规模预训练使得MM1具备了上下文学习、多图像推理等吸引人的特性,能够进行少次链式思维提示。

多模态模型

meta发布非生成路线视频模型V-JEPA

2月15日,meta公开发布视频联合嵌入预测架构 (V-JEPA) 模型。meta的副总裁兼首席人工智能科学家Yann LeCun表示:“V-JEPA 是朝着更深入地理解世界迈出的一步,因此机器可以实现更通用的推理和规划。”

他于2022年提出了最初的联合嵌入预测架构 (JEPA)。 “我们的目标是建立先进的机器智能,它可以像人类一样学习,形成周围世界的内部模型,以便有效地学习、适应和制定计划,以完成复杂的任务。”

Stability AI发布Stable Diffusion 3,与Sora同源技术

2月22日,Stability AI在早期预览版中发布了 Stable Diffusion 3,这是Stability AI最强大的文本到图像模型,在多主题提示、图像质量和拼写能力方面的性能得到了极大提高。Stable Diffusion 3模型套件目前的参数范围为800M 到8B。

3月5日,Stability AI公布了Stable Diffusion 3的技术论文,采用了一种新的多模态DiT(MMDiT,Multimodal Diffusion Transformer)模型架构,对图像与语言表示使用单独的权重集。

谷歌Gemini文生图功能紧急关闭